Introducción a la ciencia de datos

Trabajo previo¶

Lecturas¶

Çetinkaya-Rundel, Mine, & Hardin, Johanna (2021). Chapter 1: Hello data en Introduction to Modern Statistics (1st ed.). OpenIntro, Inc. https://

Wickham, Hadley; Çetinkaya-Rundel, Mirne; & Grolemund, Garret (2023). Introduction en R for Data Science: Import, Tidy, Transform, Visualize, and Model Data (2nd ed.). O’Reilly Media. https://

Introducción¶

Los científicos tratan de responder preguntas mediante métodos rigurosos y observaciones cuidadosas. Estas observaciones, recopiladas de notas de campo, encuestas y experimentos, entre otras fuentes, forman la columna vertebral de una investigación y se denominan datos (Çetinkaya-Rundel & Hardin, 2021).

La ciencia de datos es un campo multidisciplinario que estudia los datos para extraer información útil y ayudar a tomar decisiones. Combina conocimientos de matemáticas, estadística, inteligencia artificial e ingeniería de computación para analizar grandes cantidades de datos.

Datos¶

En términos generales, los datos son representaciones simbólicas (numéricas, alfabéticas, visuales o de cualquier otro tipo) susceptibles de ser comunicadas, interpretadas y procesadas para generar información o conocimiento. La norma internacional ISO/IEC 2382 (Information technology - Vocabulary) describe los datos como hechos relacionados con un objeto o evento, que pueden registrarse o transmitirse con fines de procesamiento (ISO/IEC 2382, 2015). Por su parte, Beyer y Laney (2012) señalan que los datos son la materia prima de la información y, en su conjunto, pueden constituir activos de gran valor para organizaciones y sistemas de conocimiento. Los datos, por sí mismos, no siempre constituyen información, sino que adquieren sentido al ser analizados, contextualizados y combinados.

Por ejemplo, la tabla 1 muestra un conjunto de datos conformado por registros de presencia de la especie Bradypus variegatus (perezoso de tres dedos).

| Tipo de registro | País | Localidad | Longitud | Latitud | Fecha | Observador |

|---|---|---|---|---|---|---|

| HUMAN_OBSERVATION | VE | Casa Maria und nähere Umgebung, Bejuma / Carabobo | -68.254486 | 10.282892 | 2015-02-19T00:00 | 881932368 |

| PRESERVED_SPECIMEN | CO | Unguia | -77.213341 | 8.097215 | 1950 | P. Hershkovitz |

| HUMAN_OBSERVATION | CR | La Selva Reserve | -84.003922 | 10.431209 | 2019-03-24 | User 16594 |

| HUMAN_OBSERVATION | CR | Talamanca | -82.802523 | 9.669042 | 2017-10-21 | User 5551 |

| HUMAN_OBSERVATION | VE | Casa Maria und nähere Umgebung, Bejuma / Carabobo | -68.254486 | 10.282892 | 2013-04-22T00:00 | 1665984680 |

| HUMAN_OBSERVATION | CO | Vereda Brasilar | Cerro Maco | -75.194920 | 9.885820 | 2018-07-27 | User 12345 |

| HUMAN_OBSERVATION | CR | Manuel Antonio N.P. | -84.149261 | 9.415193 | 2000-02-04 | Volunteer 1 |

| PRESERVED_SPECIMEN | PA | Pacific end of Panama Canal Zone, Canal Zone | -79.777222 | 9.133283 | 1915-01-01/2020-01-01 | Scientist X |

| HUMAN_OBSERVATION | PA | Almirante | -82.400000 | 9.300000 | 1960-01-22 | Local Observer |

| HUMAN_OBSERVATION | PA | Achiote Road | -79.990768 | 9.203782 | 2009-01-11T00:00 | Research Team |

El conjunto de datos de la tabla 1 consta de diez observaciones (filas) y siete variables (columnas). Cada una de las variables corresponde a una característica de las observaciones.

Ciencia de datos¶

Los datos, en su estado original, carecen de contexto e interpretación. La ciencia de datos es una disciplina que permite convertir datos sin procesar en comprensión y conocimiento. Combina estadística, matemáticas y programación de computadoras. A diferencia de otros enfoques de generación de conocimiento, la ciencia de datos intenta resolver problemas mediante el uso de grandes volúmenes de datos y de técnicas avanzadas de modelado, apoyándose fuertemente en la programación de computadoras y en el aprendizaje automático (machine learning). El surgimiento y la popularidad de la ciencia de datos están motivados por un incremento acelerado de la cantidad de datos existentes, así como por la disponibilidad de herramientas computacionales para procesarlos y analizarlos. Además, estos avances tecnológicos han sido apoyados por un cambio cultural propiciado por movimientos como el de ciencia abierta (open science), el cual promueve el acceso libre a la investigación científica, incluidas las publicaciones, los datos, las metodologías y el código fuente.

La figura 1 ilustra el ciclo de vida de un proyecto típico de ciencia de datos, el cual incluye los procesos de importar, ordenar, transformar, visualizar, modelar y comunicar. Todos se articulan mediante programación de computadoras.

Figura 1. Procesos de ciencia de datos. Fuente: (Wickham et al., 2023).

Importar los datos generalmente implica leerlos de un archivo, una base de datos o una interfaz de programación de aplicaciones (API) y cargarlos en estructuras apropiadas para este propósito en un lenguaje de programación.

Ordenar o estructurar los datos significa colocarlos en estructuras rectangulares de filas y columnas, similares a tablas, de manera que cada fila sea una observación y cada columna una variable.

Transformar los datos incluye, entre otras operaciones, la generación de algún subconjunto de observaciones o variables del conjunto original, la creación de nuevas variables a partir de las ya existentes o el cálculo de estadísticas como conteos y promedios.

Una vez que los datos están bien estructurados y con las variables que se requieren para el análisis, se puede proceder a la generación de conocimiento mediante dos mecanismos: la visualización y la modelización. Ambos tienen fortalezas y debilidades y es común iterar varias veces entre uno y otro.

Visualizar los datos en tablas, gráficos, mapas u otros formatos permite encontrar patrones inesperados o formular nuevas preguntas. Una buena visualización también puede indicar si se están formulando preguntas equivocadas o utilizando datos que no son apropiados para el problema que se desea resolver. Es importante tener en cuenta que las visualizaciones deben ser interpretadas por seres humanos. Por este motivo, visualizaciones como gráficos estadísticos y mapas deben ser seleccionadas con cuidado y elaborarse detalladamente.

Modelar es crear una representación abstracta y estructurada de los datos, con el fin de facilitar su análisis y realizar predicciones. Al ser herramientas matemáticas o computacionales, los modelos muchas veces pueden mejorarse mediante el empleo de mayores capacidades de cómputo, lo que los hace menos dependientes de la intervención humana, como en el caso de las visualizaciones.

Comunicar es el último paso y es una actividad crítica de cualquier proyecto de análisis de datos o de ciencia en general. No importa lo bien que los modelos y visualizaciones ayuden a entender los datos si los resultados no pueden ser comunicados a otras personas.

Estos procesos se ilustran en un cuaderno de notas Jupyter con ejemplos de procesamiento de datos de biodiversidad mediante ciencia de datos.

Reproducibilidad¶

La reproducibilidad es la capacidad de un ensayo o experimento de ser reproducido por otros. Más formalmente, en investigación cuantitativa, un análisis se considera reproducible si el código fuente y los datos utilizados por un investigador para llegar a un resultado están disponibles y son suficientes para que otro investigador, trabajando de manera independiente, pueda llegar al mismo resultado (Gangrud, 2020).

El concepto de reproducibilidad es cada vez más importante debido, entre otras razones, al aumento exponencial de datos disponibles y a la aplicación de la programación de computadoras, para procesar estos datos, por parte de especialistas de muchas disciplinas. Sin embargo, en años recientes, se ha generado una creciente preocupación debido a que muchos estudios científicos publicados fallan las pruebas de reproducibilidad.

Singleton et al. (2016) han identificado los siguientes retos para la reproducibilidad en ciencia de datos geoespaciales:

Los datos deben ser de dominio público y estar disponibles para los investigadores.

El software utilizado debe ser de código abierto (open source) y estar disponible para ser revisado.

Siempre que sea posible, los flujos de trabajo deben ser públicos y con enlaces a los datos, software y métodos de análisis, junto con la documentación necesaria.

El proceso de revisión por pares (peer review process) y la publicación académica deben requerir la presentación de un modelo de flujo de trabajo e idealmente la disponibilidad de los materiales necesarios para la replicación.

En los casos en los que la reproducibilidad total no sea posible (ej. datos sensibles), los investigadores deben esforzarse por incluir todos los aspectos que puedan de un marco de trabajo abierto.

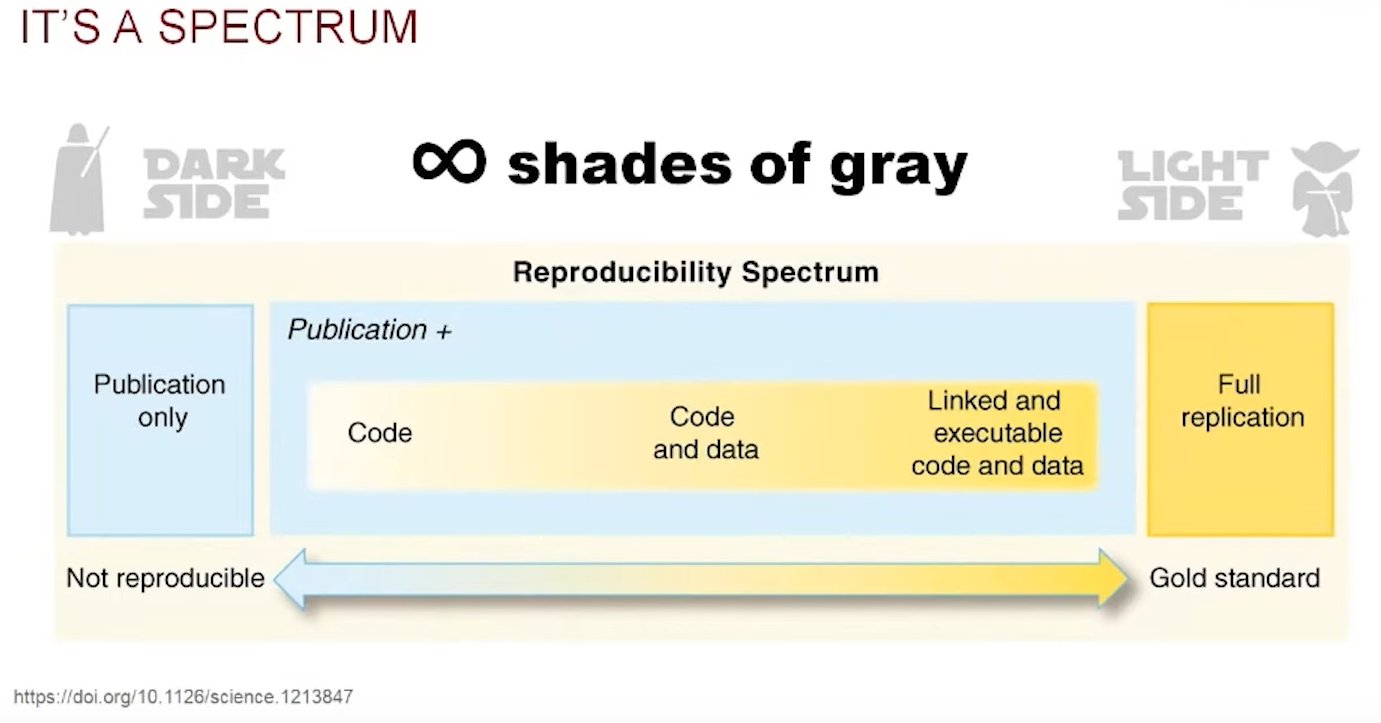

En general, el estándar mínimo de reproducibilidad requiere que los datos y el código fuente estén disponibles para otros investigadores (Peng, 2011). Sin embargo, dependiendo de las circunstancias y recursos disponibles, existe todo un espectro de posibilidades, que se ilustra en la figura 2.

Figura 2. Espectro de reproducibilidad. Fuente: Anita Graser con base en (Peng, 2011).

Herramientas¶

La implementación de un proyecto de ciencia de datos requiere del uso de herramientas informáticas como lenguajes de programación, sintaxis y formatos para documentación y sistemas de control de versiones.

Lenguajes de programación¶

Como se ha mencionado, la programación de computadoras es una actividad presente durante todos los procesos de ciencia de datos. Hay muchos lenguajes que pueden utilizarse en este campo. Entre los más populares, pueden mencionarse Python, R, SQL y JavaScript.

Sintaxis y formatos para documentación¶

La documentación es vital durante todo el ciclo de vida de una investigación reproducible. Se recomienda utilizar mecanismos estandarizados y abiertos como el lenguaje de marcado de hipertexto (HTML, en inglés, HyperText Markup Language) o Markdown, con los cuales pueden crearse documentos mediante editores de texto simples (i.e. no se requiere de software propietario), y exportables a varios formatos (ej. LaTeX, PDF).

Sistemas de control de versiones¶

Para dar mantenimiento, tanto al código fuente como a la documentación, es necesario un sistema de control de versiones como Git, el cual permite llevar el registro de los cambios en archivos y también facilita el trabajo colaborativo al reunir las modificaciones hechas por varias personas. Git es usado en varias plataformas que comparten código fuente (ej. GitHub, GitLab) y que ofrecen servicios relacionados, como hospedaje de sitios web.

Referencias bibliográficas¶

Beyer, M. A. & Laney, D. (2012). The Importance of ‘Big Data’: A Definition. Gartner. https://

Çetinkaya-Rundel, Mine, & Hardin, Johanna (2021). Chapter 1: Hello data en Introduction to Modern Statistics (1st ed.). OpenIntro, Inc. https://

Gandrud, C. (2020). Reproducible research with R and RStudio (3.a ed.). CRC Press.

ISO/IEC 2382. (2015). Information Technology - Vocabulary. International Organization for Standardization.

Peng, R. D. (2011). Reproducible research in computational science. Science, 334(6060), 1226-1227. Peng (2011)

Singleton, A. D., Spielman, S., & Brunsdon, C. (2016). Establishing a framework for Open Geographic Information science. International Journal of Geographical Information Science, 30(8), 1507–1521. Singleton et al. (2016)

Wickham, Hadley; Çetinkaya-Rundel, Mirne; & Grolemund, Garret (2023). Introduction en R for Data Science: Import, Tidy, Transform, Visualize, and Model Data (2nd ed.). O’Reilly Media. https://

- Peng, R. D. (2011). Reproducible Research in Computational Science. Science, 334(6060), 1226–1227. 10.1126/science.1213847

- Singleton, A. D., Spielman, S., & Brunsdon, C. (2016). Establishing a framework for Open Geographic Information science. International Journal of Geographical Information Science, 30(8), 1507–1521. 10.1080/13658816.2015.1137579